Xiaomi a développé un modèle d'IA de 4,7 milliards de paramètres combinant perception visuelle, parole et contrôle pour les robots.

Xiaomi entre sur le marché de la robotique

Le géant chinois des appareils mobiles et de la maison intelligente, connu sous le nom de Xiaomi, a annoncé une nouvelle étape : le développement d'un modèle d'intelligence artificielle propriétaire pour les robots. L'entreprise a présenté le Xiaomi‑Robotics‑0, un système open source combinant reconnaissance visuelle, compréhension du langage et contrôle en temps réel des actions. Le modèle compte 4,7 milliards de paramètres et a déjà établi plusieurs records tant en simulation qu'en pratique.

Comment fonctionne le modèle

Un robot suit généralement le cycle « perception → décision → action ». Xiaomi‑Robotics‑0 équilibre une compréhension large de la situation avec un contrôle précis de la motricité grâce à l'architecture Mixture‑of‑Transformers (MoT).

1. Modèle visuo-linguistique (VLM) – le « cerveau » du système.

* Appris à interpréter les commandes, même floues (« s’il vous plaît pliez la serviette »).

* Comprend les relations spatiales à partir d'images de haute qualité.

* Tâches : détection d’objets, réponses aux questions visuelles et raisonnement logique.

2. Expert en actions (Action Expert) – générateur de mouvements.

* Basé sur un transformeur diffusion (DiT).

* Ne génère pas une action à la fois ; il forme une séquence d'actions via le matching des flux, assurant fluidité et précision.

Apprentissage sans perte de compréhension

Les VLM classiques perdent une partie de leurs compétences perceptives lors de l'entraînement sur des tâches physiques. Xiaomi a résolu ce problème en entraînant simultanément le modèle sur des données multimodales (images + texte) et des données d'action. Le processus d'apprentissage comporte plusieurs étapes :

1. Proposition d'actions – le VLM prédit les distributions possibles d'actions par image, synchronisant la représentation interne avec les opérations réelles.

2. Ensuite, le VLM « se désactive », et le DiT subit un entraînement séparé pour générer des séquences précises à partir du bruit, en s'appuyant sur des caractéristiques clés plutôt que sur des tokens linguistiques.

Réduction des latences

Pour éliminer les pauses entre les prédictions du modèle et les mouvements réels du robot, une sortie asynchrone est utilisée : le calcul IA et l'action du robot sont séparés. Cela permet aux robots de se déplacer en continu même lorsqu'un calcul supplémentaire est nécessaire.

* Clean Action Prefix – méthode de rappel de l'action préalablement prédite, assurant la fluidité sans secousses.

* La masque d'attention se concentre sur la séquence visuelle actuelle, ignorant les états précédents, ce qui rend le robot plus réactif aux changements soudains de l'environnement.

Résultats

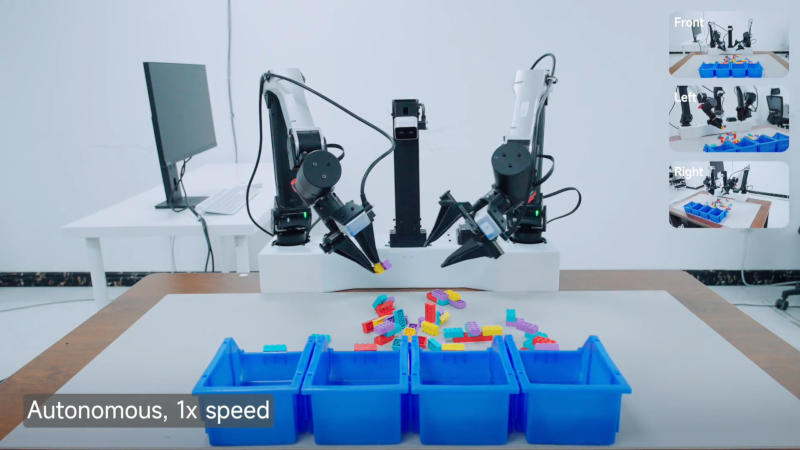

Dans les environnements simulés LIBERO, CALVIN et SimplerEnv, Xiaomi‑Robotics‑0 a surpassé environ 30 concurrents. Sur un robot réel à deux manipulateurs, le modèle a réussi des tâches complexes : plier des serviettes, démonter un constructeur. Le robot a démontré une coordination stable entre les mains et les yeux, manipulant efficacement les objets dans divers scénarios.

Ainsi, Xiaomi n'a pas seulement élargi son portefeuille de produits, mais a également posé les bases pour des recherches futures dans le domaine de l’« intelligence physique » des robots.

Asted Cloud

Asted Cloud

Commentaires (0)

Partagez votre avis — merci de rester courtois et dans le sujet.

Connectez-vous pour commenter