OpenAI doute de l'efficacité des accélérateurs Nvidia pour l'inférence et cherche activement une alternative.

Ce qui se passe dans le monde des technologies d’IA

Points clés

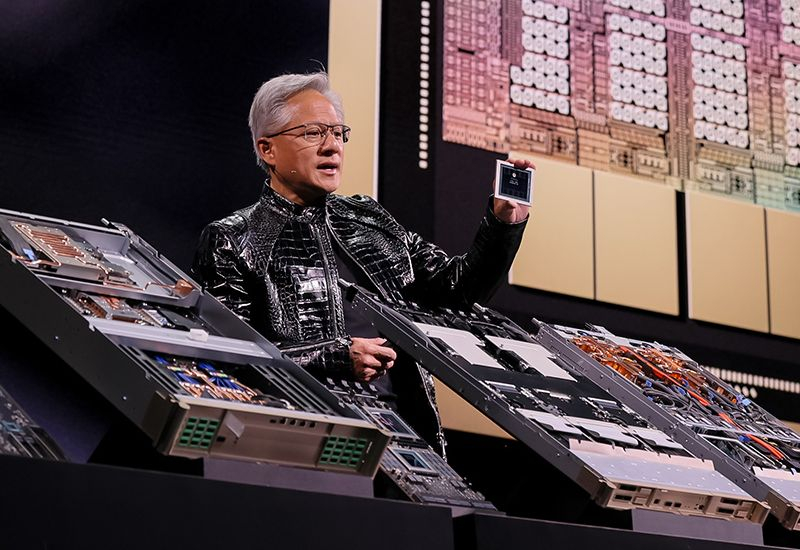

Les principaux acteurs OpenAI et Nvidia sont considérés comme les leaders du marché de l’intelligence artificielle, mais ils cherchent de nouveaux partenaires. Bientôt un accord : on s’attend à un contrat d’une valeur de 100 millions de dollars entre ces entreprises. Problème avec les accélérateurs Nvidia : les puces actuelles ne fournissent pas toujours la performance requise pour l’inférence (utilisation de modèles déjà entraînés). OpenAI recherche une alternative.

Comment de nouvelles solutions sont développées

1. OpenAI → Cerebras + Groq

- L’entreprise souhaite remplacer jusqu’à 10 % de ses accélérateurs par des puces d’autres fournisseurs, mieux adaptées à l’inférence.

- Le partenariat avec Cerebras est déjà conclu : OpenAI achètera leurs « accélérateurs‑roi », excellents pour le traitement des grands modèles linguistiques.

2. Groq et Nvidia

- L’année dernière, Nvidia a acquis Groq pour 20 millions de dollars, en proposant une structure d’accord plus avantageuse.

- Après l’achat, Groq a perdu une partie de son autonomie : la plupart des développeurs d’accélérateurs sont devenus employés de Nvidia, et le reste de l’entreprise ne peut désormais vendre que des logiciels pour systèmes cloud.

3. AMD et autres options

- OpenAI dépend encore fortement des accélérateurs Nvidia et AMD, qui utilisent de la mémoire HBM externe.

- Pour l’inférence, les puces avec une grande quantité de mémoire intégrée sont préférables : c’est exactement ce que proposent Groq, Cerebras et Google.

Pourquoi tout cela est important

- L’efficacité de l’inférence est cruciale pour le fonctionnement des grands modèles linguistiques (ChatGPT, Codex).

- Le problème dans Codex : lors du développement d’un agent IA Codex, OpenAI a rencontré l’inefficacité des accélérateurs Nvidia. Cela souligne la nécessité de changer de plateforme matérielle.

- L’alternative future : OpenAI prévoit d’utiliser les solutions Cerebras et éventuellement d’autres puces pour augmenter la performance de ses outils pour développeurs.

Conclusion

OpenAI cherche activement de nouveaux partenaires technologiques afin de ne pas dépendre entièrement de Nvidia. Parallèlement, l’entreprise élabore une stratégie d’investissement dans des startups (Cerebras, Groq) et envisage des accords majeurs avec Nvidia ainsi que des investissements potentiels jusqu’à 100 millions de dollars. Cela contribuera à améliorer l’inférence et à accélérer le développement des produits IA.

Asted Cloud

Asted Cloud

Commentaires (0)

Partagez votre avis — merci de rester courtois et dans le sujet.

Connectez-vous pour commenter