Nvidia a lancé le puce Groq 3 LPU, qui accélère l’inférence des modèles d’IA jusqu’au niveau des jetons.

Nvidia dévoile de nouvelles possibilités pour la plateforme Vera Rubin

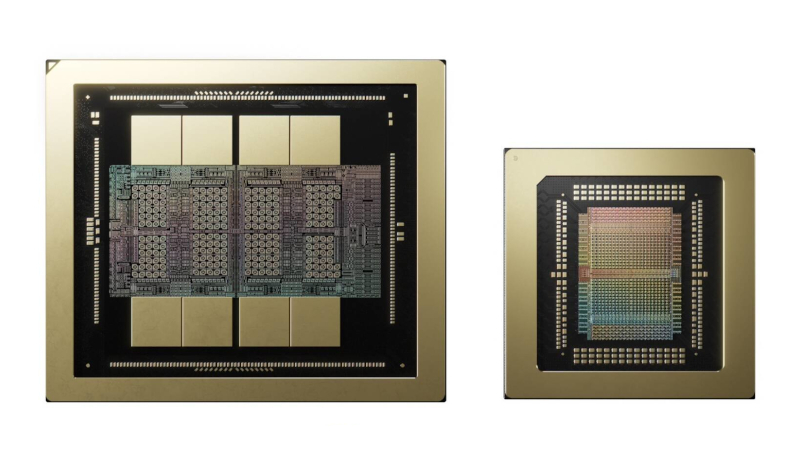

Lors de la conférence GTC de cette année, le PDG de Nvidia, Jensen Huang, a annoncé l’expansion de la plateforme Vera Rubin. Les nouvelles fonctionnalités reposent sur la propriété intellectuelle acquise auprès de Groq, et le chip *Groq 3 LPU* – un accélérateur d’inférence conçu pour délivrer des tokens à haute vitesse et faible latence – est désormais intégré à Rubin.

Ce qui existe déjà dans Vera Rubin

La plateforme se compose de six composants clés que Nvidia assemble en systèmes de rack et les évolue vers de grandes usines IA :

| Composant | Description |

|---|---|

| GPU Rubin | Carte graphique avec 288 GB HBM4 |

| CPU Vera | Processeur central |

| NVLink 6 | Système d’interconnexion intra-système |

| ConnectX‑9 | Adaptateur réseau intelligent |

| BlueField‑4 | Processeur de traitement des données |

| Spectrum‑X | Commutateur d’échelle inter-système avec optique intégrée |

Le Groq 3 LPU est désormais ajouté comme nouveau bloc de construction, utilisé lors du déploiement de grands systèmes.

Pourquoi le Groq 3 LPU se démarque

La principale différence réside dans l’architecture mémoire. Alors que la plupart des accélérateurs utilisent HBM comme mémoire de travail, chaque Groq 3 LPU contient 500 MB SRAM. Comparaison :

| Paramètre | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Capacité | 288 GB | 0,5 GB |

| Bande passante | ~22 TB/s | jusqu’à 150 TB/s |

Pour les tâches d’inférence sensibles à la bande passante, l’avantage de la SRAM est évident. C’est pourquoi Nvidia a intégré le Groq 3 dans Rubin – afin d’accroître la vitesse de délivrance des tokens.

Rack Groq 3 LPX

Le rack contient 256 chips Groq 3 LPU, ce qui donne :

- 128 GB SRAM

- 40 PB/s de bande passante totale

- 640 TB/s d’interface intra-système

Le vice-président des solutions hyper-scalables, Ian Buck, a qualifié ce rack de coprocesseur pour Rubin, soulignant son rôle dans l’amélioration des performances de décodage à chaque couche du modèle et token.

Impact sur les systèmes multi-agents

Buck a noté que le Groq 3 LPX sera un élément clé pour le futur marché IA – les systèmes multi-agents. Lorsque les agents échangent directement des données, plutôt que via des chatbots, les exigences de réponse changent : de 100 tokens/s à plus de 1 500+ tokens/s et au-delà.

Concurrents et perspectives

Le texte mentionne un concurrent – Cerebras, qui utilise le Wafer‑Scale Engine (WSE) avec une énorme SRAM pour l’inférence à faible latence. OpenAI a déjà intégré Cerebras dans ses modèles avancés grâce à sa latence avantageuse.

Buck a également souligné que l’apparition du Groq 3 LPU pourrait réduire la dépendance vis-à-vis de l’accélérateur Rubin CPX. Tant que Nvidia se concentre sur l’intégration du rack Groq 3 LPX avec la plateforme, les deux chips sont destinés à renforcer l’inférence sans nécessiter d’énormes volumes de mémoire GDDR7.

Conclusion :

Le nouveau chip Groq 3 LPU et son rack LPX renforcent Vera Rubin dans le segment de l’inférence à faible latence, ouvrant la voie à des systèmes IA multi-agents plus rapides et concurrençant des acteurs tels que Cerebras.

Asted Cloud

Asted Cloud

Commentaires (0)

Partagez votre avis — merci de rester courtois et dans le sujet.

Connectez-vous pour commenter